在之前的Blog分别介绍了vllm整体框架及使用以及在vllm中生成以及调度过程 ,本文主要介绍块管理器的原理(全部是基于:Version: 0.17.1)。

conda create -n vllm_server python=3.12

conda activate vllm_server

pip install vllm==0.17.1

在之前介绍vllm的调度过程在token_budge下去处理waiting以及running队列,对于里面如何对块进行管理没有介绍,比如说在running和waiting队列中,虽然在token_budege下running队列处理过程,通过理论计算比如说我需要running生成一个token,你的显存能够你去生成这一个token吗?以及在waiting队列处理过程中获取我已经计算过的token以及prefill能不能处理这么多new_tokens?这些都需要 kv_cache_manager过程进行管理,比如说下面代码过程:

# running 队列中获取 num_new_tokens 是不是能够被分配到block

new_blocks = self.kv_cache_manager.allocate_slots(

request,

num_new_tokens,

num_lookahead_tokens=self.num_lookahead_tokens,

)

# waiting 队列获取已经计算过的token

new_computed_blocks, num_new_local_computed_tokens = (

self.kv_cache_manager.get_computed_blocks(request)

)

# waiting 中prefill阶段能不能将所有的 num_new_tokens去分配block

new_blocks = self.kv_cache_manager.allocate_slots(

request,

num_new_tokens,

num_new_computed_tokens=num_new_local_computed_tokens,

new_computed_blocks=new_computed_blocks,

num_lookahead_tokens=effective_lookahead_tokens,

num_external_computed_tokens=num_external_computed_tokens,

delay_cache_blocks=load_kv_async,

num_encoder_tokens=num_encoder_tokens,

)

在代码中 kv_cache_manager初始化过程为:

# /vllm/v1/core/sched/scheduler.py

self.kv_cache_manager = KVCacheManager(

kv_cache_config=kv_cache_config,

max_model_len=self.max_model_len,

enable_caching=self.cache_config.enable_prefix_caching,

use_eagle=self.use_eagle,

log_stats=self.log_stats,

enable_kv_cache_events=self.enable_kv_cache_events,

dcp_world_size=self.dcp_world_size,

pcp_world_size=self.pcp_world_size,

hash_block_size=self.block_size,

metrics_collector=self.kv_metrics_collector,

)

对于初始化过程中几个关键参数解释如下:1、kv_cache_config:主要是管理 num_blocks设置(vllm/v1/kv_cache_interface.py);2、max_model_len:模型支持的最大序列长度;3、enable_caching:开启前缀缓存。

block分配整体过程

在最开始介绍vllm中的整体框架中介绍如下几个参数:1、block_szie:这个一般就是默认16块也就是每一块block存储16个tokens;2、预分配显存大小:一般就是直接 设备显存x分配比率,比如说24Gx0.9≈21.6G也就是vllm提前占用21.6G显存(但是实际kv cache占用不一定就有21.6G,在初始化过程中模型会进行一次forward去计算出,模型运行期间除了 KV cache 以外所消耗的内存);3、block数量:int(available_memory // page_size // num_layers),page_szie一个 block在单层上的字节数计算过程为(K+V)$\times$ block_size $\times$ num_kv_heads$\times$ head_size$\times$ dtype_bytes=2 $\times$ 16 $\times$ num_kv_heads $\times$ head_size$\times$ dtype_bytes。num_layers:所有kv_cache_groups中层数的最大值,除此之外vllm为模型的每一层都分配了一个独立的、形状为 [2, num_blocks, block_size, num_kv_heads, head_size] 的KV缓存张量(具体过程后面描述)。那么vllm中整体分配过程如下1:

对于每一组输入 prompt,在 prefill 阶段会根据 token 数提前分配 block:⌈num_tokens / block_size⌉ 块(例如 block_size=16,5 token 只需 1 块)。 prefill 阶段一次性把 prompt 的所有 token 的 KV 写入这些 block(对于每一个block中几个参数block_id表示当前block的序号,ref_cnt表示当前block被引用次数)。 decode 阶段是增量式的:每次只生成 1 个(或少量)新 token,如果当前最后一个 block 还有空位就继续写入;满了再申请新 block。 当 GPU KV cache 内存不足时,调度器会根据策略(默认 FCFS + 优先 decode)进行 preemption:可能把等待中的请求换出(移动到CPU中)、丢弃重排,或在某些配置下丢弃部分 running 请求。

虽然输入是多组 prompt,但 vLLM 会把它们拼接成一个“序列”来统一计算,以最大化 GPU 利用率。每个序列的 position ids 从 0 独立开始,通过 attention mask保证每组 token 只能看到自己组的信息,跨组完全隔离。 在 decode 阶段,vLLM 使用 slot_mapping tensor 来记录本次 forward 中每个要生成的新 token 对应到物理 KV cache 的哪个 slot 索引,从而实现非连续 block 的高效寻址和写入。

KVCacheManager处理过程

除了KVCache在vllm中还有一个prefix cache其作用表示当多个请求中有相同的前缀时,避免重复计算这部分内容,不过值得注意的是必须是公共前缀,中间相同并不能共享(原因很简单,decode阶段是用n-1去预测n如果两个序列中前k个都相同那么直接复用即可),比如说下面例子中

eg1:你好,帮我介绍武汉? eg2:你好,帮我介绍北京?==>就可以直接复用 “你好,帮我介绍” 这部分kv cache

eg1:你好,帮我介绍武汉? eg2:你是一个旅游专家,你好,帮我介绍北京?==>不能实现上面复用

在KVCacheManager(vllm/v1/core/kv_cache_manager.py)中核心逻辑如下几个,1、get_computed_blocks:为当前的request找到他的prefix cache;2、allocate_slots:为当前的new_token去申请分配block, 3、free:释放所有的block当request被处理完之后 ;3、cache_blocks:为prefix cache去分配block;4、reset_prefix_cache:清空所有的cache block。在了解核心逻辑之前了解block池创建过程。

blockpool创建

测试模型为:Qwen/Qwen2-0.5B-Instruct(后续具体数值和显存大小(32G)以及显存初始化大小(0.9)有关)

具体代码位置:vllm/v1/core/block_pool.py

kvcache block构建:vllm/v1/core/kv_cache_utils.py

在代码中(vllm/v1/core/block_pool.py)直接创建所有的blocks: self.blocks: list[KVCacheBlock] = [KVCacheBlock(idx) for idx in range(num_gpu_blocks)](其中 num_gpu_block大小为:131928) 而里面的KVCacheBlock创建过程比较简单,为每一块block都去创建如下属性;

值得注意的是每一个block都是一个双向队列因此prev以及next分别指向上下的block的idx,而其它熟悉含义如下:block_id当前block的序号、ref_cnt当前block被引用次数。值得注意的是上面过程只是创建了一个元数据对象还不知道具体的显存物理地址,还是在代码 vllm/v1/core/kv_cache_utils.py 中的显存分配过程:

# vllm/v1/core/kv_cache_utils.py

# 测试模型为 Qwen/Qwen2-0.5B-Instruct

def get_kv_cache_config_from_groups(vllm_config: VllmConfig, kv_cache_groups: list[KVCacheGroupSpec], available_memory: int):

if len(kv_cache_groups) == 1 and isinstance(kv_cache_groups[0].kv_cache_spec, UniformTypeKVCacheSpecs):...

else:

group_size = max(len(group.layer_names) for group in kv_cache_groups) # 24

page_size = get_uniform_page_size(

[group.kv_cache_spec for group in kv_cache_groups]

) # 8192

assert group_size > 0, "group_size must be greater than 0"

num_blocks = get_num_blocks(

vllm_config, group_size, available_memory, page_size

) # 131928

kv_cache_tensors = []

for i in range(group_size):

shared_by = []

for j in range(len(kv_cache_groups)):

if i < len(kv_cache_groups[j].layer_names):

shared_by.append(kv_cache_groups[j].layer_names[i])

kv_cache_tensors.append(

KVCacheTensor(size=page_size * num_blocks, shared_by=shared_by)

)

...

kv_cache_groups对应的结果为(测试模型为

Qwen/Qwen2-0.5B-Instruct):kv_cache_groups=[KVCacheGroupSpec(layer_names=['model.layers.0.self_attn.attn', 'model.layers.1.self_attn.attn', ..., 'model.layers.23.self_attn.attn'], kv_cache_spec=FullAttentionSpec(block_size=16, num_kv_heads=2, head_size=64, dtype=torch.bfloat16, page_size_padded=None, head_size_v=64, sliding_window=None, attention_chunk_size=None))]

最终的返回内容为:kv_cache_config=KVCacheConfig(num_blocks=131928, kv_cache_tensors=[KVCacheTensor(size=1080754176, shared_by=['model.layers.0.self_attn.attn']), ...], kv_cache_groups=[KVCacheGroupSpec(layer_names=['model.layers.0.self_attn.attn', ...], kv_cache_spec=FullAttentionSpec(block_size=16, num_kv_heads=2, head_size=64, dtype=torch.bfloat16, page_size_padded=None, head_size_v=64, sliding_window=None, attention_chunk_size=None))])

1080754176= page_size* num_blocks= 8192x131928

上述代码主要是计算需要分配的显存大小和block数量,除此之外会对模型中每一层都去计算需要分配的kv_cache_tensor大小,比如说上面代码计算得到每一层结果都是:8192* 131928,也就是我的就会对每一层分配一个这么大的内容去显存中占用,直接去看具体显存分配过程,在代码(vllm/v1/worker/gpu_model_runner.py)中的初始化kv_cache_tensor过程如下:

# vllm/v1/worker/gpu_model_runner.py

def initialize_kv_cache_tensors(self, kv_cache_config: KVCacheConfig, kernel_block_sizes: list[int]):

...

else:

# 创建 kv_cache_tensors

kv_cache_raw_tensors = self._allocate_kv_cache_tensors(kv_cache_config)

# 修改 kv_cache_tensor 形状

kv_caches = self._reshape_kv_cache_tensors(kv_cache_config, kv_cache_raw_tensors, kernel_block_sizes)

return kv_caches

对于里面的创建 kv_cache_tensors过程则是直接通过 tensor = torch.zeros(kv_cache_tensor.size, dtype=torch.int8, device=self.device)去初始化一层的张量其大小为 kv_cache_tensor(page_size* num_blocks=8192x131928),而后将其分配给每一层 for layer_name in kv_cache_tensor.shared_by: kv_cache_raw_tensors[layer_name] = tensor而后将每层中分配得到的tensor大小通过 _reshape_kv_cache_tensors 处理,将最开始的 page_size* num_blocks的修改为 kv_cache_shape,让每个层真正需要的 KV cache 形状和 stride 布局,其中得到的kv_cache_shape为:(2, 131928, 16, 2, 64)对应 (K+V, num_blocks, block_size, num_kv_heads, head_size)。

也就是将上面提到的 KVCacheTensor 中每个size大小等于K+V$\times$ num_blocks$\times$ block_size$\times$ num_kv_heads$\times$ head_size$\times$ dtype_bytes

这样一来,整个 KV Cache 的物理显存占用和元数据管理由两大部分组成:物理 KV 数据存储部分(真正占大头显存) 在 kv_cache_tensors 创建和 reshape 阶段,vLLM 为模型的每一层 attention(或每个 KV cache group)提前分配好了对应的 KVCacheTensor。 形状为:(2, num_blocks, block_size, num_kv_heads, head_size)(比如说:(2, 131928, 16, 2, 64)) 这部分是真正存储 K 和 V 数值的显存。 每一层都有自己独立的(或通过 view 共享底层内存的)tensor。 所有层的 tensor 都使用相同的 num_blocks(131928) 作为第一维(block 维度)。 全局 Block 元数据管理部分(几乎不占显存) 在 BlockPool 中一次性创建:list[KVCacheBlock] = [KVCacheBlock(idx) for idx in range(num_gpu_blocks)] 这 num_gpu_blocks 个 KVCacheBlock 对象只保存元数据(block_id、ref_cnt、block_hash、last_access_time 等),不存储任何 KV 数据。

总结:block_pool想象成一个大池塘,当一个请求需要分配新的block时,就会从free_block_queue取出对应数量的block,如果不够,那就分配失败,当请求完成,释放所有block时,就将请求下的所有block释放回free_block_queue。

block分配逻辑

上面简单介绍了如何去分配每层中的显存占用以及创建block,下面介绍输入一个新的request如何去分配block进行占用。以上面waiting分配过程为例:KVCacheManager中初始block协调器(self.coordinator = get_kv_cache_coordinator)–> get_kv_cache_coordinator去选择不同的协调器通过 allocate_new_blocks去分配新的block,其内部逻辑是通过 manager进行配分–> manager实现逻辑在 get_manager_for_kv_cache_spec中通过不同的attention计算方式选择不同的分配方式(vllm/v1/core/single_type_kv_cache_manager.py)。

# get_kv_cache_coordinator 选择kvcache分配器 以KVCacheCooridantor为例 kv_cache_coordinator.py

def allocate_new_blocks(

self,

request_id: str,

num_tokens: int,

num_tokens_main_model: int,

num_encoder_tokens: int = 0,

) -> tuple[list[KVCacheBlock], ...]:

return tuple(

manager.allocate_new_blocks(

request_id,

num_encoder_tokens

if isinstance(manager, CrossAttentionManager)

else num_tokens,

num_tokens_main_model,

)

for manager in self.single_type_managers

)

# 里面 self.single_type_managers 主要是通过 get_manager_for_kv_cache_spec获取,其代码定义位置为 single_type_kv_cache_manager.py

# get_manager_for_kv_cache_spec支持的attention分配逻辑

spec_manager_map: dict[type[KVCacheSpec], type[SingleTypeKVCacheManager]] = {

FullAttentionSpec: FullAttentionManager,

MLAAttentionSpec: FullAttentionManager,

SlidingWindowSpec: SlidingWindowManager,

ChunkedLocalAttentionSpec: ChunkedLocalAttentionManager,

MambaSpec: MambaManager,

CrossAttentionSpec: CrossAttentionManager,

SinkFullAttentionSpec: SinkFullAttentionManager,

}

在 get_manager_for_kv_cache_spec 支持多种attention都是继承 SingleTypeKVCacheManger,主要去看其内部的 allocate_new_blocks 和 allocate_new_computed_blocks 这两部分代码逻辑,在 new_blocks中:比较简单直接计算需要分配的blocks数量(cdiv=a//b,用新的生成的tokens数量除block_size而后取整即可),而后去我的block pool去拿出对应数量的block即可。对于 new_computed_blocks则是从prefix cache中去拿出已经被处理过程的cache,那么上述整个cache block分配逻辑如下:

比如说我的模型只有4层,而后我输入token数量是50个,block_size是16这样一来就需要4个block才能存下所有的tokens,首先去检查prefix cache(也就是allocate_new_computed_blocks过程)假设前 2 个逻辑 block 已经缓存在 KV cache 中,那么req_to_blocks值假如就是 block_table = [10, 21, null, null]前两个是真实 hit 的 block_id,后两个先占位,而后通过 allocate_new_blocks计算还需要2个block去存储剩下的tokens假设得到的是45,67那么最后我的tokens存储的block_table就是 [10, 21, 45, 67]那么去计算prefill处理,这个过程就是直接拿着这个block_table去实际物理地址中去找(上面我的每一层提前缓存了 (2, 131928, 16, 2, 64)–(2, num_blocks, block_size, num_kv_heads, head_size) 这么多tensor)那么对于每一层

layer-0: kv_cache_layer0[:, [10,21,45,67], ...]

...

layer-3: kv_cache_layer0[:, [10,21,45,67], ...]

此时我的blok没有被填满,而后持续deocde到被填满(分配了4个刚刚好64个被填满)此时需要新的block加入是89那么拿出添加到 block_table中即可,而后依次类推。

Prefix Cache逻辑

Prefix Cache指的是缓存已处理请求的 kv-cache 块,并在新请求到达时重用这些块,前提是新请求与先前请求具有相同的前缀2。在推理框架SGLang中一个比较明显特点就是Prefix Cache不过两者在逻辑上存在差异,vllm是基于block而SGLang则是基于token级别的,也就是说vLLM中只有block被填满了斌且block内都是相同的才能复用prefix cache。在此之前在vllm中的block管理结构如下,block都是一个双链表,彼此之间都知道前后的block,比如说

第 0 个 block(tokens 0~15): hash0 = hash( NONE_HASH + tuple(tokens[0:16]) + extra_keys )

第 1 个 block(tokens 16~31): hash1 = hash( hash0 + tuple(tokens[16:32]) + extra_keys )

以此类推后续都是如此。不过必须注意的是:只有在你的block被完全填满(比如说有16个token)之后才会为这个block添加上hash标志!

在介绍调度器中,对于waiting队列管理中有一个逻辑就是 new_computed_blocks, num_new_local_computed_tokens = self.kv_cache_manager.get_computed_blocks(request) 通过kv_manager去获取已经被计算过的blocks以及新的本地计算计算的tokens,这部分代码内容逻辑如下:

# kv_cache_manager.py

def get_computed_blocks(self, request: Request) -> tuple[KVCacheBlocks, int]:

if not self.enable_caching or request.skip_reading_prefix_cache:

return self.empty_kv_cache_blocks, 0

computed_blocks, num_new_computed_tokens = (

self.coordinator.find_longest_cache_hit(

request.block_hashes, # 请求预先计算好的 block hash 列表(链式)

request.num_tokens - 1

)

)

...

return self.create_kv_cache_blocks(computed_blocks), num_new_computed_tokens

从代码中对于被计算过的blocks获取方法直接通过 find_longest_cache_hit 去获取,这部分代码内部逻辑是我直接去遍历所有的KVCacheBlock中去看哪些 hash 是对应的,如果找到对应的那就可以直接复用即可,直接用官方例子来解释:

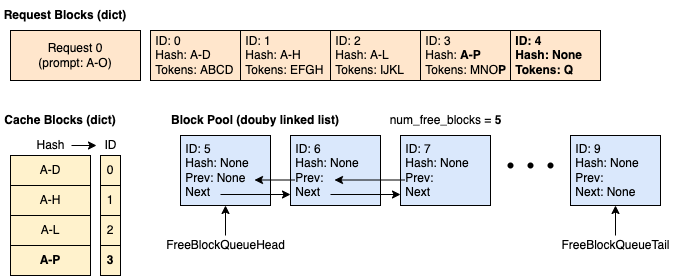

时间1:缓存为空,输入request0(prompt为A-O)总共19个token。直接从block pool中分配了 4 个块。其中 3 个已满那么就会被缓存(直接使用SHA256进行编码,编码逻辑是: sha256( parent_hash + 本块tokens + extra ) 分别表示上一个列表、本block token、额外信息)。第四个块部分填充了 3 个 token。

时间2:开始decode处理,这样就会对 request0 使块3填满,并请求新块以继续解码,这个时候有4块被填满那么就会在cache block中建立4个hash

时间 3:request1 到达,带有 14 个提示 token(A-J,k-n),其中前 10 个 token 与请求 0 相同。我们可以看到只有前 2 个块(8 个 token)命中缓存,因为第 3 个块只匹配了 4 个 token 中的 2 个。其具体的命中缓存内部逻辑如下,比如开始 request1在预分配的4个block其中前三块都是被填满建立索引假设是 *0 *1 *2 *3 (在我的request0中建立hash是 *0 *1 *4 *5 *6)那么会去调用 find_longest_cache_hit(request.block_hashes) 去cache blocks进行查找发现request2中 *2没有命中,那么直接复用 *0 以及 *1。也就对应下面图像中 request1服用了ID0和ID1,比如说代码:

@classmethod

def find_longest_cache_hit(cls, block_hashes, max_length, ...):

computed_blocks = tuple([] for _ in range(len(kv_cache_group_ids)))

max_num_blocks = max_length // block_size

for block_hash in itertools.islice(block_hashes, max_num_blocks):

# 直接去 blocks_hashes 中查找

if cached_block := block_pool.get_cached_block(block_hash, kv_cache_group_ids):

# 遇到匹配的cahce

for computed, cached in zip(computed_blocks, cached_block):

computed.append(cached)

else:

break

if use_eagle and computed_blocks[0]:

for computed in computed_blocks:

computed.pop()

return computed_blocks

时间 4:请求 0 完成并释放。块 2、3 和 4 按反向顺序添加到空闲队列(但块 2 和 3 仍被缓存)。块 0 和 1 未添加到空闲队列,因为它们正在被请求 1 使用

时间 5:请求 1 完成并释放。

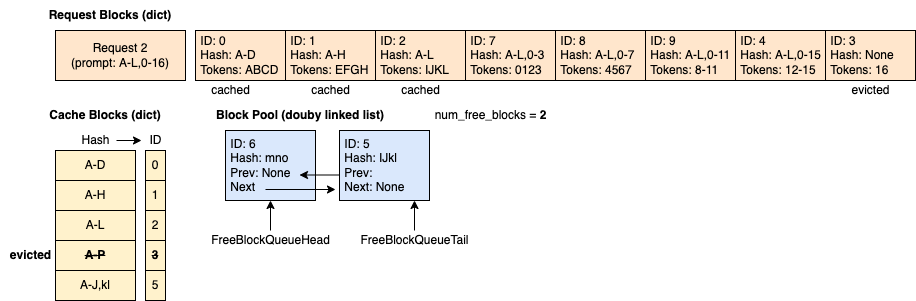

时间 6:请求 2 到达,带有 29 个提示 token,其中前 12 个 token 与请求 0 相同。请注意,即使空闲队列中的块顺序是 7 - 8 - 9 - 4 - 3 - 2 - 6 - 5 - 1 - 0,缓存命中的块(即 0、1、2)在分配前会被触碰并从队列中移除,因此空闲队列变为 7 - 8 - 9 - 4 - 3 - 6 - 5。结果,分配的块是 0(已缓存)、1(已缓存)、2(已缓存)、7、8、9、4、3(已驱逐)。

总结

KVCache中几个核心的代码文件:1、 kv_cache_manager.py:对block进行分配(不过核心调度代码在 kv_cache_coordinator.py中),包括输入新的token去计算需要多少block、prefix cache使用;2、block_pool.py:创建blook池核心就是根据计算得到的num_blocks去计算分配多少全局管理的block: KVCacheBlock;3、gpu_model_runner.py:直接为模型的每一层去占用物理显存,并且对于占用的物理显存通过全局的 KVCacheBlock进行管理。

对于block pool想象成一个池子总共有num_blocks个每个池子只能存储 block_size个token,我提前对我模型中每一层都分配了一个 (K+V, num_blocks, block_size, num_kv_heads, head_size)大小的张量进行占用,所有物理块共享这块连续的 GPU 内存,通过 block_id 进行分页索引,在新的prompt输入时候计算需要分配池子数量 len(tokens)//block_size,而后会将所有的token都放到池子中,对于填满了的池子会用一个hash标记放到block hash中,新的输入时候,进行hash计算如果在block hash中有重复的直接复用(prefix cache过程),而在具体计算中就直接根据block需要去分配的层中进行索引,比如说某个prompt分配了[1,2]那么计算过程就是 (K+V, [2,3], block_size, num_kv_heads, head_size) 去复用kv cache。当prompt被解码之后,他的block会放到block pool中,而且cache还在,新的输入过来就去检查是不是有被计算过程直接复用!